Avrupa’nın AI Yasasından beş büyük çıkarım

AI Yasası oylaması ezici bir çoğunlukla kabul edildi ve AI düzenlemesinde dünyanın en önemli gelişmelerinden biri olarak müjdelendi. Avrupa Parlamentosu başkanı Roberta Metsola, bunu “hiç şüphesiz önümüzdeki yıllarda küresel standardı belirleyecek olan yasa” olarak tanımladı.

Yine de herhangi bir ani netlik için nefesinizi tutmayın. Avrupa sistemi biraz karışık. Daha sonra, Avrupa Parlamentosu üyeleri, taslak kurallar yasalaşmadan önce Avrupa Birliği Konseyi ve AB’nin yürütme kolu olan Avrupa Komisyonu ile ayrıntıları ele almak zorunda kalacak. Nihai mevzuat, üç kurumdan çok farklı olan üç farklı taslak arasında bir uzlaşma olacaktır. Yasaların fiilen uygulanması muhtemelen yaklaşık iki yıl alacaktır.

Çarşamba günkü oylamanın başardığı şey, Avrupa Parlamentosu’nun yaklaşmakta olan nihai müzakerelerdeki konumunu onaylamaktı. Çevrimiçi platformlar için yasal bir çerçeve olan AB’nin Dijital Hizmetler Yasasına benzer şekilde yapılandırılmış olan AI Yasası, yasa koyucuların bir AI uygulamasının ne kadar tehlikeli olabileceğini öngörmesine dayalı kısıtlamalar getirerek “riske dayalı bir yaklaşım” benimsiyor. İşletmeler ayrıca yapay zeka kullanımlarıyla ilgili kendi risk değerlendirmelerini sunmak zorunda kalacak.

Yasa koyucuların riski “kabul edilemez” olarak değerlendirmesi durumunda bazı AI uygulamaları tamamen yasaklanacak, “yüksek riskli” olarak kabul edilen teknolojilerin kullanımlarında yeni sınırlamalar ve şeffaflıkla ilgili gereklilikler olacaktır.

Önemli sonuçlardan bazıları şunlardır:

- Duygu tanıma AI yasağı. Avrupa Parlamentosu’nun taslak metni, polislik, okullar ve işyerlerinde insanların duygularını tanımaya çalışan yapay zeka kullanımını yasaklıyor. Duygu tanıma yazılımı yapımcıları, AI’nın bir öğrencinin belirli bir materyali ne zaman anlamadığını veya bir araba sürücüsünün ne zaman uykuya daldığını belirleyebildiğini iddia ediyor. Yüz tespiti ve analizi yapmak için yapay zekanın kullanılması, yanlışlık ve önyargı nedeniyle eleştirildi, ancak diğer iki kurumun taslak metninde yasaklanmadı, bu da yaklaşmakta olan siyasi bir mücadele olduğunu düşündürüyor.

- Kamusal alanlarda gerçek zamanlı biyometri ve tahmine dayalı polisliğin yasaklanması. Bu büyük bir yasama mücadelesi olacak, çünkü çeşitli AB organlarının yasağın yasada uygulanıp uygulanmayacağını ve nasıl uygulanacağını çözmesi gerekecek. Polis grupları, modern polislik için gerekli olduğunu düşündükleri gerçek zamanlı biyometrik teknolojilerin yasaklanmasından yana değil. Fransa gibi bazı ülkeler aslında yüz tanıma kullanımlarını artırmayı planlıyor.

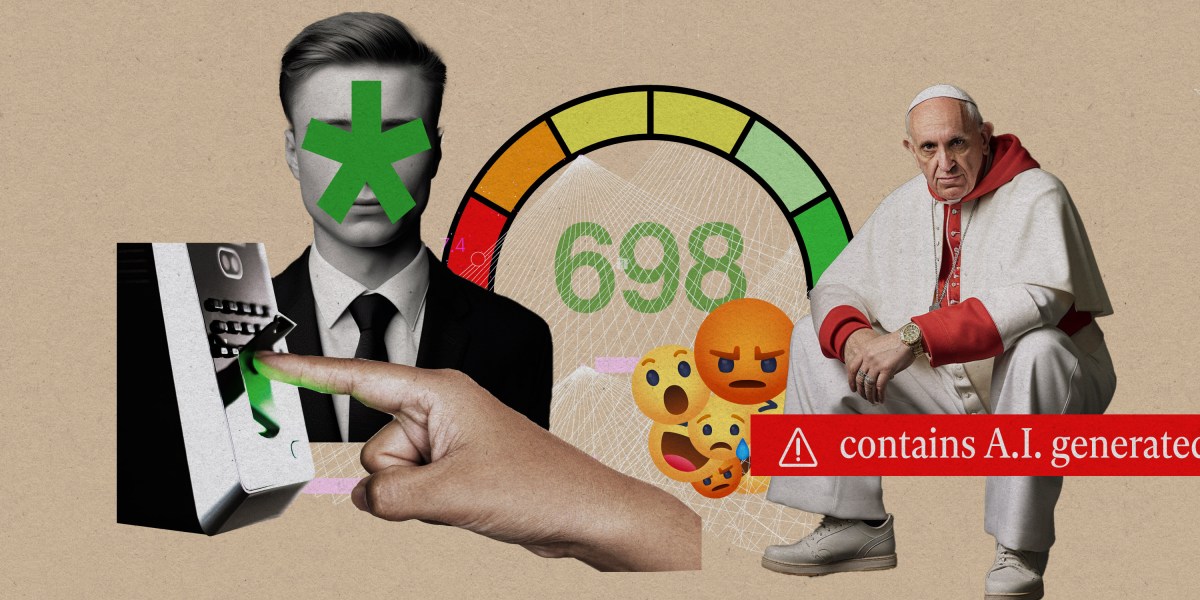

- Sosyal puanlama yasağı. Kamu kurumları tarafından yapılan sosyal puanlama veya genellemeler ve profiller yapmak için insanların sosyal davranışları hakkındaki verileri kullanma uygulaması yasa dışı olacaktır. Bununla birlikte, genellikle Çin ve diğer otoriter hükümetlerle ilişkilendirilen sosyal puanlamaya ilişkin görünüm, göründüğü kadar basit değildir. İnsanları değerlendirmek için sosyal davranış verilerini kullanma uygulaması, işe alma ve reklam vermenin yanı sıra ipotek dağıtma ve sigorta oranlarını belirlemede yaygındır.

- Gen AI için yeni kısıtlamalar. Bu taslak, üretici yapay zekayı düzenlemenin yollarını öneren ve OpenAI’nin GPT-4’ü gibi büyük dil modellerinden oluşan eğitim setinde telif hakkıyla korunan herhangi bir materyalin kullanımını yasaklayan ilk taslaktır. OpenAI, veri gizliliği ve telif hakkıyla ilgili endişeler nedeniyle şimdiden Avrupalı yasa koyucuların incelemesine girdi. Taslak ayrıca yapay zeka tarafından oluşturulan içeriğin bu şekilde etiketlenmesini gerektiriyor. Bununla birlikte, Avrupa Parlamentosu artık politikasını Avrupa Komisyonu’na ve teknoloji endüstrisinden lobicilik baskısıyla karşılaşması muhtemel olan tek tek ülkelere satmak zorunda.

- Sosyal medyadaki tavsiye algoritmalarına yeni kısıtlamalar. Yeni taslak, öneri sistemlerini, önerilen diğer yasa tasarılarından bir üst kademe olan “yüksek riskli” bir kategoriye yerleştiriyor. Bu, geçerse, sosyal medya platformlarındaki tavsiye sistemlerinin nasıl çalıştıkları konusunda çok daha fazla incelemeye tabi olacağı ve teknoloji şirketlerinin kullanıcı tarafından oluşturulan içeriğin etkisinden daha fazla sorumlu olabileceği anlamına gelir.

AB Komisyonu Başkan Yardımcısı Margrethe Vestager tarafından açıklanan yapay zeka riskleri çok yaygın. Bilgiye olan güvenin geleceği, kötü aktörler tarafından yapılan sosyal manipülasyona karşı savunmasızlık ve kitlesel gözetim hakkındaki endişeleri vurguladı.

Vestager Çarşamba günü gazetecilere verdiği demeçte, “Hiçbir şeye inanmadığımız bir duruma düşersek, toplumumuzu tamamen baltalamış oluruz” dedi.

Bu hafta ne okuyorum

- Wall Street Journal tarafından yayınlanan video görüntülerine göre, bir Rus askeri Ukraynalı bir insansız hava aracına teslim oldu. Teslim Mayıs ayında Ukrayna’nın doğusundaki Bakhmut şehrinde gerçekleşti. İHA operatörü, askerin savunmasını videoyla görünce uluslararası hukuka göre canını bağışlama kararı aldı. Dronlar savaşta kritik öneme sahip ve teslimiyet, savaşın geleceğine büyüleyici bir bakış.

- Birçok Reddit kullanıcısı, sitenin API’sinde üçüncü taraf uygulamalarının ve birçok topluluğun kullandığı araçların işlevini ortadan kaldıracak veya azaltacak değişiklikleri protesto ediyor. Protesto olarak, bu topluluklar “gizli hale geldi”, bu da sayfaların artık herkese açık olmadığı anlamına geliyor. Reddit, kullanıcı tabanına verdiği güçle tanınıyor ancak Casey Newton’un keskin değerlendirmesine göre şirket artık bundan pişmanlık duyuyor olabilir.

- Google’ın geniş dil modeli Bard’ı eğiten sözleşmeli çalışanlar, çalışma koşulları ve güvenlik sorunlarıyla ilgili endişelerini AI’nın kendisiyle dile getirdikten sonra kovulduklarını söylüyor. Müteahhitler, doğrulukla ilgili endişelere yol açan makul olmayan son teslim tarihlerini karşılamak zorunda kaldıklarını söylüyorlar. Google, sorumluluğun işçileri çalıştıran sözleşmeli ajans Appen’e ait olduğunu söylüyor. Tarih bize bir şey söylerse, üretici yapay zekaya hükmetme yarışında bir insan maliyeti olacaktır.

Bu hafta ne öğrendim

İnsan Hakları İzleme Örgütü bu hafta Ürdün’de refah yardımlarını dağıtmak için kullanılan bir algoritma hakkında ayrıntılı bir rapor yayınladı. Ajans, Dünya Bankası tarafından finanse edilen algoritmada bazı önemli sorunlar buldu ve sistemin yoksullukla ilgili yanlış ve aşırı basitleştirilmiş varsayımlara dayandığını söylüyor. Raporun yazarları ayrıca şeffaflık eksikliğine dikkat çekti ve Dünya Bankası tarafından yürütülen benzer projelere karşı uyarıda bulundu. Bulgular hakkında kısa bir hikaye yazdım.

Bu arada, devlet hizmetlerinde algoritma kullanma eğilimi artıyor. Elizabeth Renieris, yazarı Verinin Ötesinde: Meta Evrenin Şafağında İnsan Haklarını Geri Kazanmak, rapor hakkında bana yazdı ve bu tür sistemlerin ileriye dönük etkisinin altını çizdi: “Avantajlara erişim süreci varsayılan olarak dijital hale geldikçe, bu faydaların onlara en çok ihtiyaç duyanlara ulaşma olasılığı daha da azalıyor ve yalnızca derinleşiyor. dijital uçurum. Bu, kapsamlı otomasyonun insanları nasıl doğrudan ve olumsuz etkileyebileceğinin en iyi örneği ve şimdi odaklanmamız gereken yapay zeka risk konuşması.”