Bir yapay zeka tarafından cinsel olarak nesneleştirilmek nasıl bir duygu?

Bu hikaye ilk olarak AI hakkındaki haftalık haber bültenimiz The Algorithm’de yayınlandı. Bunun gibi hikayeleri önce gelen kutunuza almak için buradan kaydolun.

Bu haftaki sosyal medya beslemelerime iki sıcak konu hakim oldu: OpenAI’nin en yeni sohbet robotu ChatGPT ve viral AI avatar uygulaması Lensa. Yeni teknolojilerle uğraşmayı seviyorum, bu yüzden Lensa’yı denedim.

MIT Technology Review’daki meslektaşlarıma benzer sonuçlar almayı umuyordum. Uygulama onlar için gerçekçi ve pohpohlayıcı avatarlar oluşturdu; astronotları, savaşçıları ve elektronik müzik albüm kapaklarını düşünün.

Bunun yerine, tonlarca çıplak fotoğrafım var. Oluşturduğum 100 avatardan 16’sı üstsüzdü ve diğer 14’ünde aşırı derecede cimri giysiler ve açıkça cinselleştirilmiş pozlar vardı. Hikayemi buradan okuyabilirsiniz.

Lensa, avatarlarını metin istemlerine dayalı olarak görüntüler oluşturan açık kaynaklı bir yapay zeka modeli olan Stable Diffusion’ı kullanarak oluşturur. Kararlı Difüzyon, internetten görüntüleri kazıyarak derlenmiş devasa bir açık kaynak veri seti olan LAION-5B üzerinde eğitilmiştir.

Ve internet, çıplak veya zar zor giyinmiş kadınların resimleriyle ve cinsiyetçi, ırkçı klişeleri yansıtan resimlerle dolup taştığı için, veri seti de bu tür resimlere doğru eğiliyor.

Asyalı bir kadın olarak hepsini gördüğümü sanıyordum.Eski bir randevunun sadece Asyalı kadınlarla çıktığını fark ettikten sonra kendimi kötü hissettim. Asyalı kadınların harika ev kadınları olduğunu düşünen erkeklerle kavga ettim. Cinsel organlarım hakkında kaba yorumlar duydum. Odadaki diğer Asyalı kişiyle karıştırıldım.

Bir yapay zeka tarafından cinselleştirilmek, şaşırtıcı olmasa da beklediğim bir şey değildi. Açıkçası, ezici bir şekilde hayal kırıklığı yarattı. Meslektaşlarım ve arkadaşlarım, kendilerinin sanatsal temsillerine stilize edilme ayrıcalığına sahip oldular. Avatarlarında tanınıyorlardı! Değildim. Açıkça anime karakterleri veya video oyunları üzerinde modellenmiş genel Asyalı kadınların resimlerini aldım.

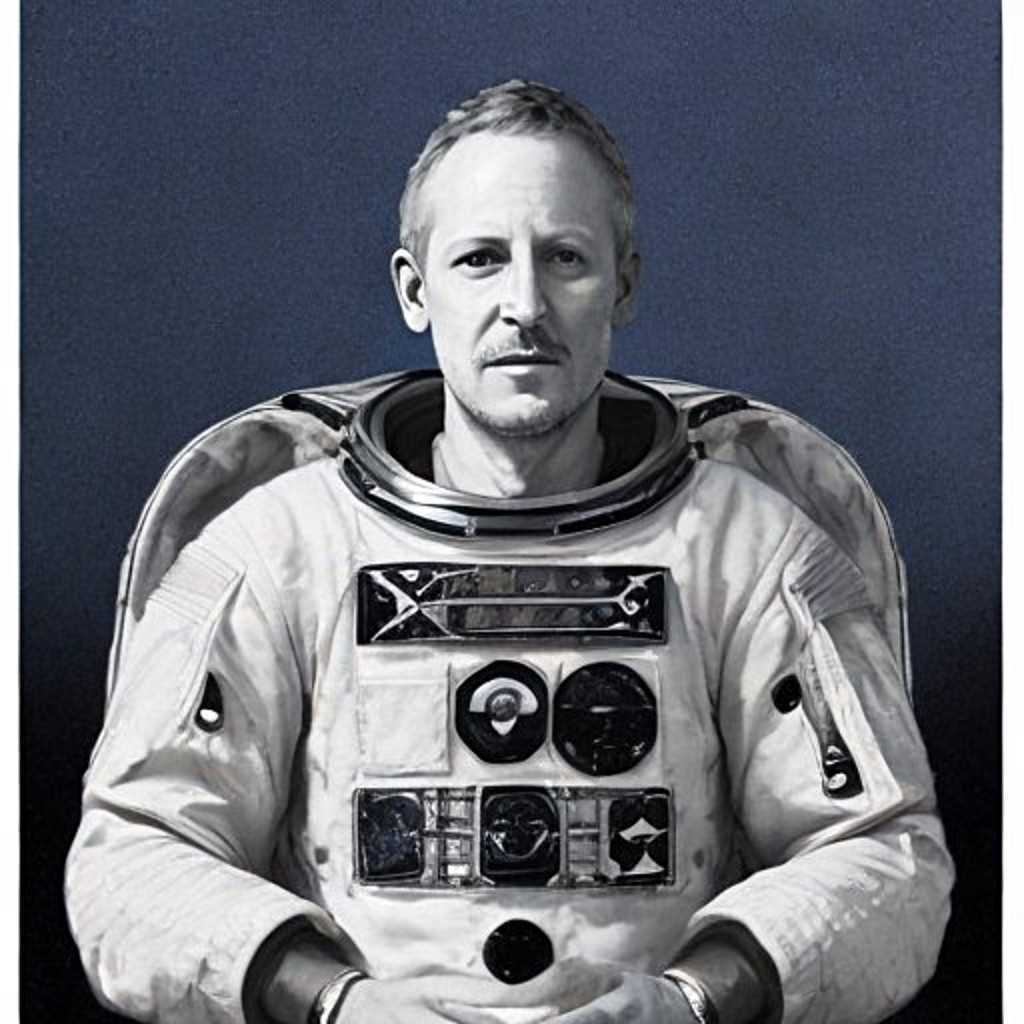

Yeterince komik, uygulamaya erkek olduğumu söylediğimde kendimin daha gerçekçi tasvirlerini buldum. Bu, muhtemelen görüntülere farklı bir dizi bilgi istemi uyguladı. Farklılıklar keskindir. Erkek filtreleri kullanılarak oluşturulan görüntülerde üzerimde giyiniyorum, iddialı görünüyorum ve -en önemlisi- fotoğraflarda kendimi tanıyabiliyorum.

“Kadınlar cinsel içerikle ilişkilendiriliyor,oysa erkekler tıp, bilim, iş ve benzeri herhangi bir önemli alanda profesyonel, kariyerle ilgili içerikle ilişkilendirilir” diyor.

Bu tür klişeleştirme, yapay zeka girişimi Hugging Face’te çalışan araştırmacı Sasha Luccioni tarafından geliştirilen ve herkesin Stable Diffusion’daki farklı önyargıları keşfetmesine olanak tanıyan yeni bir araçla kolayca tespit edilebilir.

Araç, AI modelinin beyaz erkeklerin doktor, mimar ve tasarımcı olarak resimlerini sunarken, kadınların kuaför ve hizmetçi olarak nasıl tasvir edildiğini gösteriyor.

Ancak suçlanacak olan sadece eğitim verileri değil.Carnegie Mellon Üniversitesi’nde görüntü oluşturma algoritmalarında önyargılar üzerine çalışan doktora öğrencisi Ryan Steed, bu modelleri ve uygulamaları geliştiren şirketlerin verileri nasıl kullanacakları konusunda aktif seçimler yaptığını söylüyor.

“Birinin eğitim verilerini seçmesi, modeli oluşturmaya karar vermesi, bu önyargıları azaltmak için belirli adımlar atıp atmayacağına karar vermesi gerekiyor” diyor.

Lensa’nın arkasındaki şirket olan Prisma Labs, tüm cinsiyetlerin “ara sıra cinselleşme” ile karşı karşıya kaldığını söylüyor. Ama bana göre bu yeterince iyi değil. Birisi, belirli renk şemalarını ve senaryoları uygulamak ve belirli vücut kısımlarını vurgulamak için bilinçli bir karar verdi.

Kısa vadede, bu kararların, kadın veya çocukların rıza dışı çıplak görüntülerini oluşturan derin sahte jeneratörlere kolay erişim gibi bazı bariz zararları olabilir.

Ancak Aylin Çalışkan, ileride daha da uzun vadeli sorunlar görüyor. Gömülü ön yargılarıyla yapay zeka tarafından oluşturulan görüntüler interneti doldururken, sonunda gelecekteki yapay zeka modelleri için eğitim verileri haline gelecekler. “Bu önyargıları büyütmeye ve popülasyonları marjinalleştirmeye devam edeceğimiz bir gelecek mi yaratacağız?” diyor.

Bu gerçekten korkutucu bir düşünce ve umarım sorun daha da büyüyüp daha da derinleşmeden önce bu konulara gereken zamanı ve önemi veririz.

Derin Öğrenme

Savunuculuk kuruluşları Action Center on Race and Economy (ACRE), LittleSis, MediaJustice ve Göçmen tarafından hazırlanan yeni bir rapora göre, şehirlerin terör saldırılarına hazırlanmasına yardımcı olmayı amaçlayan hibe parası, ABD polis departmanları için “büyük miktarda gözetim teknolojisi satın alınmasına” harcanıyor Savunma Projesi gösterir.

AI destekli casus teknoloji için alışveriş:Örneğin, Los Angeles Polis Departmanı, en az 1,27 milyon $ değerinde otomatik plaka okuyucuları, 24 milyon $ değerinde radyo ekipmanı, Palantir veri füzyon platformları (genellikle yapay zeka destekli tahmine dayalı polislik için kullanılır) ve sosyal medya satın almak için terörle mücadeleye yönelik fon kullandı. medya izleme yazılımı.

Bu neden önemli: Çeşitli nedenlerden dolayı, pek çok sorunlu teknoloji, çok az veya hiç gözetim olmadan polislik gibi yüksek riskli sektörlerde sona eriyor. Örneğin, yüz tanıma şirketi Clearview AI, teknolojisinin “ücretsiz denemelerini” polis departmanlarına sunuyor, bu da polis departmanlarının bir satın alma sözleşmesi veya bütçe onayı olmadan kullanmalarına olanak tanıyor. Terörle mücadeleye yönelik federal hibeler, çok fazla kamu şeffaflığı ve gözetimi gerektirmez. Raporun bulguları, vatandaşların polis teknolojisi tedariki konusunda giderek daha fazla karanlıkta bırakıldığı, büyüyen bir modelin bir başka örneği. Tate Ryan-Mosley’den daha fazlasını buradan okuyun.

Bitler ve Baytlar

hatGPT, Galactica ve ilerleme tuzağı

Yapay Zeka araştırmacıları Abeba Birhane ve Deborah Raji, (Meta’nın Galactica’sında görüldüğü gibi) “model yayınlamaya yönelik eksik yaklaşımların” ve kritik geri bildirime karşı son derece savunmacı tepkinin, şu anda yapay zekada “son derece endişe verici” bir eğilim oluşturduğunu yazıyor. Modeller “onlardan zarar görme olasılığı en yüksek olanların beklentilerini karşılamadığında”, “ürünlerinin bu topluluklara hizmet etmeye hazır olmadığını ve geniş çapta piyasaya sürülmeyi hak etmediğini” öne sürüyorlar. (Kablolu)

Yeni chatbot’lar dünyayı değiştirebilir. Onlara güvenebilir misin?

İnsanlar, ChatGPT’nin ne kadar tutarlı olduğu karşısında şaşkına döndü. Sorun şu ki, püskürttüğü şeylerin önemli bir kısmı saçmalık. Büyük dil modelleri, kendine güvenen saçmalıklardan başka bir şey değildir ve onlara bunu göz önünde bulundurarak yaklaşmamız akıllıca olur.

(New York Times)

Sözleriyle tökezleyen bazı insanlar yapay zekanın konuşmasına izin veriyor

Teknolojinin kusurlarına rağmen, öğrenme güçlüğü çekenler gibi bazı kişiler, kendilerini ifade etmelerine yardımcı olmak için büyük dil modellerini hâlâ yararlı buluyor.

(Washington post)

AB ülkelerinin AI kurallarına ilişkin duruşu, milletvekilleri ve aktivistlerden eleştiri alıyor

AB’nin AI yasası, AI Yasası, kesinleşmeye yaklaşıyor. AB ülkeleri, düzenlemenin nasıl olması gerektiği konusundaki tutumlarını onayladı, ancak eleştirmenler, şirketler tarafından halka açık yerlerde yüz tanıma kullanımı gibi birçok önemli konunun ele alınmadığını ve birçok güvencenin sulandırıldığını söylüyor. (Reuters)

Yatırımcılar üretken yapay zeka girişimlerinden kar elde etmeye çalışıyor

Sadece sen değilsin. Risk sermayedarları ayrıca, popüler metinden görüntüye model Stable Diffusion’ı yaratan Stability.AI gibi üretken yapay zeka girişimlerinin şu anda teknolojideki en sıcak şeyler olduğunu düşünüyor. Ve üzerlerine tonlarca para fırlatıyorlar. (Finansal Zamanlar)